Резюме

Вопрос: Где взять опыт работы если без него не берут?

Ответ: Адаптировать

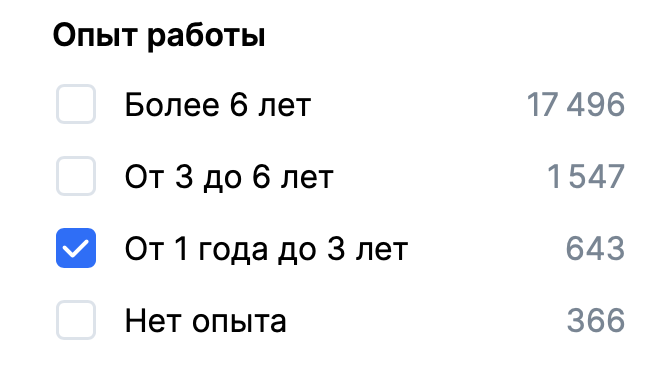

Чтобы попасть на тех собес, вам нужно пройти автофильтры рекрутеров по годам опыта. Важно, чтобы в вашем резюме была проставлена именно правильная цифра. Стажировок для НЕ СТУДЕНТОВ мало. Есть конечно компании, которые вас нанимают стажером или джуном, но перепродают большим бигтехам, как сеньера. Разницу естественно забирают себе. Справедливо ли это - решать вам. Мне такой подход не нравится.

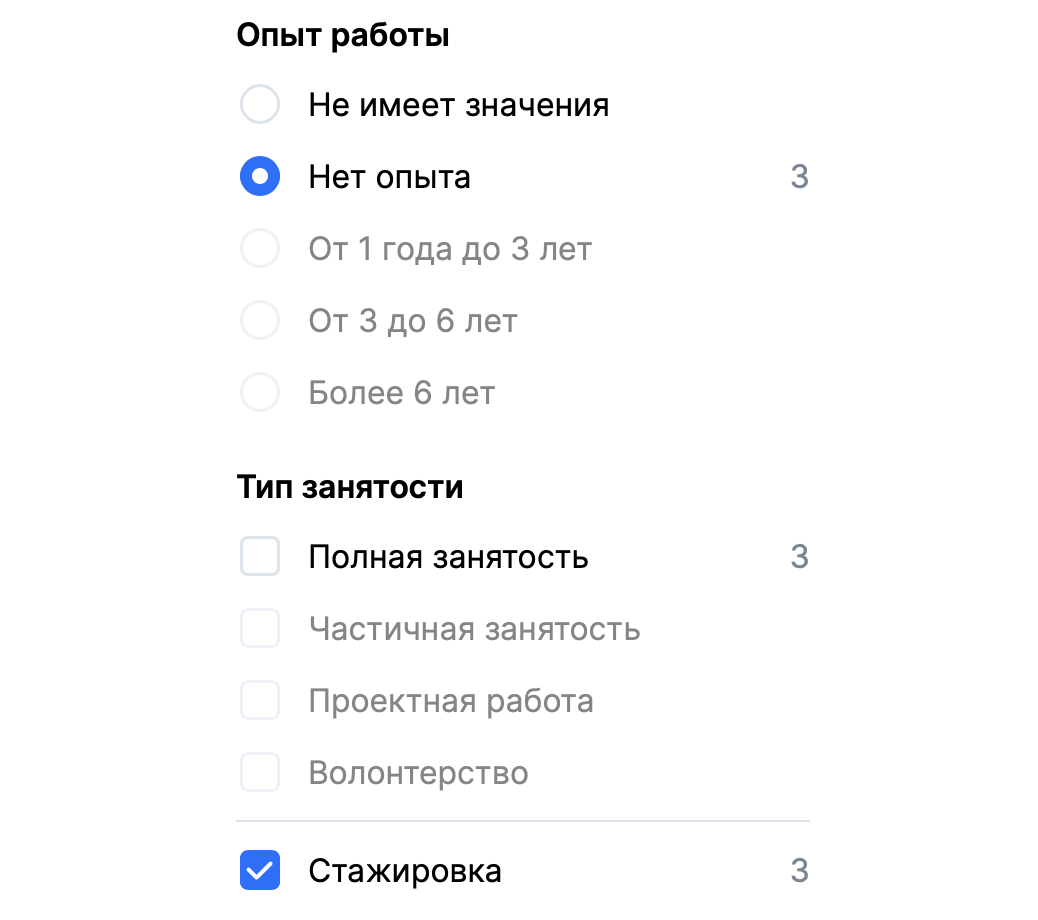

Стажировка

Если вы студент, то можете во время учебы запрыгнуть на SberSeasons. В целом норм вариант пока вы учитесь. Там прям берут студентов последних курсов технических университетов.

Если вы закончили универ вчера или 100 лет назад, то для вас СТАЖИРОВОК немного. Платить там могут до 100к. Если вам надо жить в Москве, у вас семеро детй и четверо козлят - возможно зарплаты в 60к вам не хватит. Здесь я рекомендую сразу идти на junior или junior+.

И по деньгам это будет от 120к на руки. Хотя у меня лично есть примеры, когда люди залетали сразу на мидла на 200к на руки. Нужны будут пруфы - пиши мне в телегу.

Как составить резюме?

Большая часть материала взята из этого источника (opens in a new tab)

Советы универсальные, но часть заточена под платформу Head Hunter

Базированная База

- Резюме нужно, чтобы "продать" себя нанимающей стороне и у них не осталось вопросов, почему ТЕБЯ должны взять на это место.

Сделай PDF

- У тебя всегда должно быть 2 резюме, одно на платформе поиске работы, а другое - сохраненное в PDF файл, которое будешь отправлять по запросу (например в телеге).

Шапка

-

Заполняй ФИО, свой город, контакты

-

Рядом с номером телефона в комментарии укажи свой ТГ (для XX - больше вероятность, что напишут напрямую)

-

Городом указывай - Москва или Питер. Только если не нужен конкретный регион или работа в местном офисе

-

Возраст - если уже победил кризис среднего возраста или еще бывший школьник, то возраст не указывай. Эйджизм дело такое...

-

Поставь нормальное "живое" фото, примерно, как на паспорт. Если ты на нем улыбаешься, вообще замечательно. Никаких фото с клуба с бутылочкой 🍾 минералки в руке. Нет нормального фото, тогда не ставь. Если ты школьник, тоже не ставь

-

Должность пиши, как в большинстве вакансий для твоего стека (Data Engineer). Грейд нигде тоже не указывай, если только не претендуешь на Лида и выше. Никаких Middle Питон Девелопер, вот как на ХХ написано, так и пиши

-

Не указывай ЗП, могут предложить больше чем ты хотел изначально. Исключение - отсечение по нижней границе для синьоров с опытом и ЗП 400к+

Опыт работы

❗️ ВАЖНО ДЛЯ ТЕХ КТО РАБОТАЕТ ПО СЗ, ГПХ, ИП или служит по контракту (военный). В этих случаях подтвердить опыт работы документально будет проблематично. У вас есть два варианта решения проблемы: Написать Study | Pet Project или ООО "Рога и Копыта" или ООО "Связь" (для военных).

Толковых ребят с военки реально много, и к сожалению никого не волнует, что вы защищали свою Родину, а теперь у вас нет записи в выписке из Трудовой книжке.

Я не против, если вы сделаете себе резюме сразу на Middle-Senior. Походите на собесы. Задачи собеседующих проверить ваши компетенции. Можете просто даже протестировать рынок и понять, насколько много или мало надо знать на такие деньги. В случае, если вы успешно пройдете собес и получите оффер на 350к с ходу, я могу либо поздравить вас с отличными навыками, либо поругать тим лида с той стороны, который плохо вас прособеседовал. Ведь к собесу надо готовиться не только кандидату, но и собеседующей стороне!

Важный момент. Если вы с ходу получили оффер на хорошие деньги, взвесьте все ЗА и ПРОТИВ перед соглашением. Если у вас нет реального опыта, то будет очень тяжело. Оптимально идти все-таки на начальные или средние позиции в крупные компании, где медленные процессы, чтобы было время освоиться.

Года опыта

-

Пишите 2 года опыта на текущем месте работы (даже если вы пожарный или медсестра). Можно написать Study | Pet Project (в целом это проходит фильтры HR и вам могут писать рекрутеры САМИ). Но эффективнее, если опыт будет адаптирован. Забудьте про всю свою предыдущую жизнь. На крайнем месте работы вам удалось переключиться на задачи, связанные с данными. Позиции дата инженера/аналитика у компании не было, так как это были нецелевые задачи компании. Вы автоматизировали сбор данных и наладили дашборд для руководства. Вам так это понравилось, что вы решили свичнуться в DE и начать работать с реальной Big Data. Вы сочиняете себе легенду.

-

Легенда является легендой только в рамках того, что это была реальная задача в компании. Вам реально надо собрать проект по типу HallatapeETLPipeline (opens in a new tab) и по возможности адаптировать идею под свой род деятельности. На собесе проверяют глубину знания инструмента и степень его владения, а не качество выполняемой работы на предыдущем месте.

| Пример легенды |

|---|

| Работал аналитиком (по факту монтажником). Написал телеграм-бота, который собирал данные по расходникам с каждого объекта и складывал всё в СУБД PostgreSQL. Всё было развёрнуто в Docker на сервере, и каждый вечер/неделю/месяц Airflow читал данные из БД и внутри pandas или PySpark строил витрины/отчёты для руководства. |

- Описывайте свой опыт с указанием всех ключевых слов

| Настроил парсинг и загрузку данных в хранилище | ❌ |

| Настроил парсинг данных из API с помощью pandas и requests, а также загрузку в ClickHouse при помощи Airflow; настроил DAG мониторинга данных и сборки витрин с помощью dbt | ✅ |

НЕРЕЛЕВАНТНЫЙ ОПЫТ

- Удаляйте весь нерелевантный опыт. Даже, если у вас за плечами 10-20 лет спасения жизни человечества или продажи галстуков в пустыне – это никак не поможет в поиске работы Дата Инженера. Мы не спасаем мир и не продаем галстуки. Только работа с данными.

❗️❗️ Крутить можно и больше. Вопрос только в том, насколько вы готовы за это брать ответственность. На 2-3 года накрученного опыта вас будут спрашивать конкретные кейсы (примеры решенных задач). Я рекомендую идти либо на джуна, либо на джун+. Через год вы станете уже мидлом и сможете мощно заявлять любые шестизначные суммы.

Образование

- Указываем обязательно, если оно есть, хоть какое-то. Особенно высшее. Даже не оконченное и не ИТ-шное. Показывает, что человек обучаем и не совсем "улиточка" 🐌

Языки

- Пиши все которые знаешь. Уровень указывай, как чувствуешь, но чем выше тем лучше

Стажировки

- Никаких стажировок указывать не надо. Так же не пиши, что ничего не знаешь и "готов работать за еду, только возьмите меня"

Курсы

- Курсы не пишем, особенно те, что у всех на слуху. Исключение - курсы повышение квалификации которые котируются именно в твой области и их наличие показатель для нанимающей стороны.

Навыки

- На ХХ (HeadHunter) можно указать навыки в количестве 30 штук. Указывай все, что он предлагает для твоего стека и с чем ты работал. "Стрессоустойчивость" и "работу в команде" и похожее указывать не нужно. Если делаешь шаблон сам, то можешь сделать отдельный блок Скиллы\Skills

Программист-водитель

- Никаких прав "Категории - В" указывать не нужно. ХХ любит добавлять их самостоятельно, проверяем и убираем

Рекомендации

- Убираем. Если это не знаковая фигура, которую все знают или известна в твоей области

О себе

- Обязательно надо оставить контактную информацию в самом конце (пример ниже). Вам будут больше писать, открытие контактов в HH платное.

Для связи:

ТГ - @ilon_mask

почта - IlonMask@om.nom

телефон - 8 (800) 555-35-35

*проще позвонить, чем у кого-то занимать*🏁 Финально

-

Размер резюме должен быть такой, чтобы читающий понял, что ты нужный им человек. При этом не устал читать и не закрыл его. Для ХХ при экспорте в PDF размер не более 2 страниц А4, максимум 3. Для своей PDF - в идеале 1 страница, для разработчиков с опытом - 2.

-

Твое резюме должно быть минимум на трех сайтах:

| HH.ru (opens in a new tab) | Linkedin (opens in a new tab) | Хабр Карьера (opens in a new tab) |

Примеры резюме (можно копировать)

Кради, как художник

Пример 1 — Финтех + Производство (Data Engineer)

Опыт работы — 2 года 9 месяцев

Работодатель 1

Москва

Финансовый сектор

• Банк

Data Engineer

- Организовала миграцию данных из S3 в кластер YTsaurus, настроила регулярное поступление новых данных в кластер с помощью Airflow

- Оптимизировала витрины данных, переведя их с ежесуточного обновления на инкрементальное обновление каждые полчаса

- Разрабатывала и поддерживала новые и существующие DAG для обработки петабайт данных в рамках единой сессии Apache Spark

- Настроила мониторинг и алертинг DAG-ов с отслеживанием пропущенных данных и перезапуском упавших задач с помощью алертов, сенсоров и триггеров

- Участвовала в сборе требований и разработке нового архитектурного решения для хранения данных при переезде с DataVault (Hive) на DataLake (Iceberg)

- Занималась ad-hoc аналитикой, построением аналитических дашбордов

Работодатель 2

Москва

Электроника, приборостроение, бытовая техника, компьютеры и оргтехника

• Промышленное, бытовое электрооборудование и электротехника (производство)

Товары народного потребления (непищевые)

• Посуда, свет, товары для дома (продвижение, оптовая торговля)

• Посуда, свет, товары для дома (производство)

Data Engineer

- Автоматизировала ETL-процессы с помощью Airflow, перенеся задания с crontab

- Разработала и внедрила систему прогнозирования продаж с использованием ML (Gradient Boosting), что повысило точность прогнозов на ~20%

- Создала витрины данных для BI-аналитиков и отдела продаж, наладила мониторинг качества данных и выявление аномалий

- Менторила стажеровПример 2 — Рекламный рынок (Data Engineer)

Опыт работы — 3 года 10 месяцев

Работодатель 3

Москва

Data Engineer

Ключевые обязанности:

- разработка и поддержка ETL/ELT-пайплайнов с использованием Python, dbt, Apache Airflow, MS SQL, ClickHouse

- интеграция данных из API рекламных платформ (Google Analytics, Яндекс.Метрика, VK, Ozon и т.д.), S3, FTP, Яндекс Диска, Google Sheets

- проектирование и развитие DWH на MS SQL Server, S3, ClickHouse

- взаимодействие с аналитиками и бизнес-заказчиками для формирования требований и построения витрин для различного вида отчетности

Ключевые достижения:

- автоматизировал процессы формирования отчетности по рекламным кампаниям, снизив долю ручного труда

- участвовал в миграции архитектуры ETL/DWH: MS SQL + Prefect + dbt -> Greenplum + Airflow + dbt + ClickHouse (переписал 50+ скриптов, dbt моделей)

- реализовал более 10 витрин для дашбордов в Tableau

- разработал 15+ скриптов для интеграции с внешними API (Wildberries, Ozon, Admitad, Яндекс Трекер и т.д.), что расширило источники данных для аналитики

- оптимизировал SQL-запросы и ETL-процессы, повысив производительность загрузки данных

- внедрил схему «звезда» для 5+ площадок, что сократило время формирования отчетов на 50%

Английский язык — уровень B2 (средне-продвинутый)

Технологический стек:

Базы данных и хранилища: MS SQL Server, PostgreSQL, Greenplum, ClickHouse, S3

Языки программирования: SQL, Python 3

Инструменты и фреймворки: Apache Airflow, Prefect, dbt (Data Build Tool), SSIS, Docker, Spark

Системы управления задачами: Jira, Yandex Tracker, GitПример 3 — Ритейл-платформа (Data Engineer)

Опыт работы — 3 года 2 месяца

Работодатель 4

Data Engineer

Проект: OMNI Platform — единая омниканальная платформа данных для ритейла

Команда: 2 архитектора, 8 Data Engineers, техлид, аналитики, инфраструктурные инженеры, PM

Результат (impact):

- сократил время сборки ключевой витрины продаж с 3 часов до 40 минут за счет внедрения PIT-таблиц и устранения data skew

- завершил миграцию домена «Продажи и Лояльность» на Data Vault 2.0, обеспечив единый источник правды для аналитических и продуктовых команд

- повысил стабильность DWH, внедрив блокирующие DQ-проверки, предотвращающие загрузку неконсистентных данных в продакшн

Задачи и технологии (tech):

- реализовал Raw Data Vault (Hubs, Links, Satellites) для доменов «Продажи» и «Акции»

- внедрил hash-based CDC для идемпотентной загрузки и корректного ведения истории

- построил отказоустойчивые пайплайны загрузки из S3 (Parquet) в Greenplum через External Tables с автоматической фильтрацией битых записей без остановки DAG-ов

- мигрировал dbt-процессы с Bash на KubernetesPodOperator, обеспечив изоляцию окружений и гибкое управление параметрами (включая бэкфиллы)

- оптимизировал модель хранения и джойны: задал единый distribution key и разработал PIT-таблицы в Business Data Vault

Стек: Greenplum 6.x, Airflow, dbt Core 1.6+, ClickHouse, S3, Kubernetes, Docker, Python, Data Vault 2.0Пример 4 — Онлайн-сервис (Data Engineer)

Работодатель 5

Москва

Информационные технологии, системная интеграция, интернет

• Интернет-сервис (поисковики, платежные системы, соцсети, информационно-познавательные и развлекательные ресурсы, продвижение сайтов и прочее)

Data Engineer

Работаю в большой команде из дата-инженеров. Мигрируем из Snowflake на Greenplum-ClickHouse.

Вся инфраструктура на базе Yandex Cloud.

Ключевые достижения:

- оптимизировал загрузку данных в Scala Spark из S3 в Greenplum, устранив ошибки OOM и disk spill за счет динамической пакетной обработки файлов, что обеспечило эффективную загрузку крупных таблиц

- настроил раздельное хранение для таблиц >1 TB в Greenplum с помощью плагина Yezzey, что снизило нагрузку и увеличило скорость чтения на 50%, а также позволило реализовать быстрые инкрементальные обновления и историческую аналитику

- разработал API на Python для загрузки данных в S3 с объектно-ориентированным подходом, используя PostgreSQL для хранения метаданных о структуре и правилах хранения данных, а также Pandas для трансформации данных, обеспечив надежную и эффективную передачу

- разработал коннектор для резервного копирования Kafka в S3, расширив хранение данных более чем на 2 дня и обеспечив надежное восстановление и повторную обработку при сбоях или задержках в Spark

- реализовал CI/CD-пайплайн на GitHub Actions для отслеживания PL/SQL-функций, используя Alembic для детектирования изменений, их валидации и генерации таблицы с модификациями и ошибками в GitHub Summary

Технологический стек:

Python, Spark, Spark Streaming, ClickHouse, Greenplum, S3, Kafka, Debezium, API, Pandas, Argo Workflow, dbt, Docker, ScalaПример 5 — Розничная сеть (Дата Инженер)

Опыт работы — 3 года 10 месяцев

Май 2025 — настоящее время (7 месяцев)

Работодатель 6

Санкт-Петербург

Розничная торговля

• Розничная сеть (продуктовая)

Дата Инженер

Работаю в команде с дата аналитиками. Airflow, Spark на K8S. S3 в YandexCloud.

- Разработал несколько пайплайнов загрузки данных из внешних API в ClickHouse, реализовав контроль качества данных, автоматические ретраи и логирование ошибок в отдельную витрину ClickHouse, что повысило надежность и прозрачность процессов.

- Оптимизировал Spark-джобы, существенно снизив затраты на вычисления за счет корректировки Spark-конфигураций (уменьшение количества executors, числа ядер и выделяемой памяти), без потери производительности в YandexCloud DataProc.

- Создал с нуля основную часть проекта: модульную OOP-архитектуру, включающую компоненты для загрузки данных в Spark, S3 и ClickHouse, а также модуль для интеграции с ClickHouse Connect на Python, обеспечив масштабируемость и удобство сопровождения кода.

- Реализовал кастомный сенсор в Apache Airflow для загрузки ретро-данных, использующий метаданные для выборки нужных файлов. Дополнительно внедрил механизм дедупликации на базе ReplacingMergeTree, что обеспечило корректность исторических данных.

- Развернул и настроил полную инфраструктуру для разработки и тестирования (Airflow, ClickHouse, PostgreSQL, Spark, JupyterLab, S3) в Docker, а также реализовал CI/CD-деплой из GitHub, что ускорило командную разработку и упростило доставку изменений.

Технологический стек:

Python, Spark, ClickHouse, PostgreSQL, S3, API, Pandas, Airflow, Docker, K8S, YandexCloudПример 6 — Маркетинговая аналитика (Data Engineer)

Data Engineer

Работаю в команде дата-инженеров, которая создает инфраструктуру для маркетинговых аналитиков.

Строим сквозную аналитику по розничным и корпоративным продуктам для оценки эффективности рекламных кампаний.

Реализованные задачи:

♦ Автоматизировал ETL-процесс сборки витрин данных по розничным и корпоративным продуктам на PySpark (Airflow + Python + Spark). Благодаря обновлению исторических витрин увеличил количество успешных сделок по продуктам.

♦ Оптимизировал тяжелые SQL-запросы в ClickHouse, внедрил dbt. Сократил время выполнения запроса и уменьшил объем SQL-кода в 10 раз.

♦ Настроил проверку качества данных в Apache Airflow (построение DAG) с помощью dbt-моделей. Ежедневно приходят отчеты об отклонениях и задержках в загрузке данных.

♦ Увеличил скорость принятия решений и взаимодействия между командами: подготовил документацию и UML-схемы по витринам данных в Confluence.

♦ Разработал скрипт ежедневного контроля ключевых метрик рекламных кампаний с выводом в дашборд Apache Superset.

♦ Снизил нагрузку на Hadoop (HDFS) за счет оптимизации хранения мелких файлов.

Рабочий процесс:

1. Работа по спринтам (Scrum)

2. Документация в Confluence

3. Постановка и трекинг задач в Jira

4. Хранение данных в Hadoop

Стек:

Spark, Python, Airflow, Docker, Pandas, Superset, ClickHouse, dbt, Hadoop, YARN, Hive, Jupyter Notebook, PyCharm, HUE, VSCode, DBeaver, Data Vault, Anchor, нормализация, оконные функции, модели данных, индексы в БД, draw.io